L’intelligenza artificiale sembra fare enormi progressi.

È diventata la tecnologia chiave che sta alla base delle auto a guida autonoma, dei sistemi di traduzione automatica, dell’analisi vocale e testuale, dell’elaborazione delle immagini e di molti sistemi di diagnosi e riconoscimento.

In molti casi, l’intelligenza artificiale può superare i migliori livelli di prestazione umana in compiti specifici.

Stiamo assistendo alla nascita di una nuova realtà commerciale con un’intensa attività, massicci investimenti finanziari e un enorme potenziale.

Sembrerebbe che non ci siano aree che non possano essere migliorate dall’IA, nessun compito che non possa essere automatizzato, nessun problema che non possa almeno essere parzialmente semplificato da un’applicazione di IA. Ma è davvero così?

Il problema dell’aumento di scala

Studi teorici di calcolo hanno dimostrato che ci sono alcune cose che non sono calcolabili. Alan Turing, il brillante matematico e decifratore di codici, ha dimostrato che alcuni calcoli potrebbero non esaurirsi mai (mentre altri richiederebbero anni o addirittura secoli).

Per esempio, possiamo facilmente calcolare qualche mossa in anticipo in una partita a scacchi, ma considerare tutte le mosse alla fine di una partita media a scacchi (circa 80 mosse) è assolutamente impraticabile.

Anche usando uno dei supercomputer più veloci al mondo, in grado di elaborare più di centomila trilioni di operazioni al secondo, ci vorrebbe più di un anno per esplorare solo una piccola porzione della scacchiera.

Questo è anche noto come problema dell’aumento di scala.

Le prime ricerche sull’IA hanno spesso prodotto buoni risultati su un numero ridotto di combinazioni di un problema ma non sarebbero stati all’altezza di quelli più numerosi.

Fortunatamente, l’IA moderna ha sviluppato modi alternativi per affrontare tali problemi. Questi computer possono infatti battere i migliori giocatori umani del mondo, non prevedendo in anticipo tutte le possibili mosse, ma guardando più lontano di quanto la mente umana possa gestire.

Lo fanno usando metodi che implicano approssimazioni, stime di probabilità, grandi reti neurali e altre tecniche di apprendimento automatico.

Ma questi sono più che altro problemi di informatica, non di intelligenza artificiale. Esistono dei limiti oggettivi per l’intelligenza artificiale?

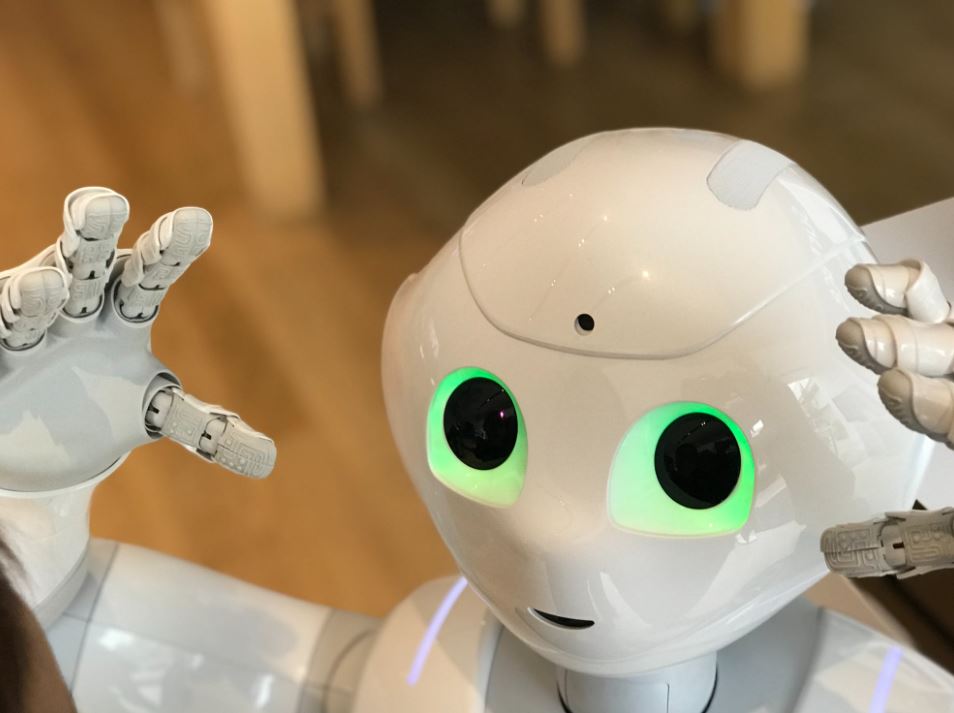

Il problema diventa chiaro quando si considera l’interazione uomo-macchina. Ci si aspetta, infatti, che i futuri sistemi di IA comunichino con gli esseri umani e li assistano in scambi sociali amichevoli, in modo completamente interattivo.

Teoria della mente

Naturalmente, abbiamo già versioni primitive di tali sistemi. Ma i sistemi di di risposta vocale e l’elaborazione di dialoghi in stile call center fanno solo “finta” di essere conversazioni.

Ciò che serve sono delle vere e proprie interazioni sociali, che comportino conversazioni a flusso libero durante le quali i sistemi di intelligenza artificiale riescono a riconoscere le persone e le conversazioni precedenti. L’intelligenza artificiale dovrà comprendere le intenzioni e il significato di ciò che le persone dicono.

LEGGI ANCHE: Perché non dovremmo umanizzare l’intelligenza artificiale

Questo richiede ciò che in psicologia è conosciuto come teoria della mente, la comprensione che la persona con cui stai parlando ha un modo di pensare, e vede il mondo più o meno nello stesso modo in cui lo vedi tu. Così, quando qualcuno parla delle sue esperienze, puoi apprezzare ciò che descrive e come si relaziona con te, dando un significato ai suoi commenti.

Osserviamo anche le azioni della persona e deduciamo le sue intenzioni e preferenze dai gesti e dai segnali. Così, quando Lucia dice: “Penso che a Giuseppe piaccia Rita, ma crede che lei lo trovi inadatto“, sappiamo che Lucia ha un modello del primo ordine di se stessa (i suoi pensieri), un modello del secondo ordine dei pensieri di Giuseppe, e un modello del terzo ordine di ciò che Giuseppe pensa che Rita pensi.

L’apprendimento fisico

È chiaro che tutta questa interazione sociale ha senso per le parti coinvolte solo se hanno un “senso del sé” e possono analogamente mantenere un modello del sé dell’altro agente.

Per capire qualcun altro, è necessario conoscere se stessi. Un “modello del sé” dell’IA dovrebbe includere una prospettiva soggettiva, che coinvolga il modo in cui il suo corpo opera (per esempio, il suo punto di vista visivo dipende dalla posizione fisica dei suoi occhi), una mappa dettagliata del proprio spazio, e un repertorio di abilità e azioni ben comprese.

Ciò significa che è necessario un corpo fisico per basare il senso di sé in dati ed esperienze concrete. Quando un’azione di un agente è osservata da un altro, può essere compresa reciprocamente attraverso le componenti condivise dell’esperienza. Ciò significa che l’IA sociale dovrà essere realizzata in robot dotati di corpi fisici.

Come può una scatola con un software software avere un punto di vista soggettivo sul mondo fisico, sul mondo in cui vivono gli esseri umani? I nostri sistemi di conversazione non devono essere solo incorporati, ma anche incarnati.

Un progettista non può costruire in modo efficace il senso di sé di un software per un robot. Se un punto di vista soggettivo fosse progettato fin dall’inizio, sarebbe il punto di vista del progettista, e dovrebbe anche imparare e affrontare esperienze sconosciute al progettista. Quindi ciò di cui abbiamo bisogno per progettare è una struttura che supporti l’apprendimento di un punto di vista soggettivo.

Fortunatamente, c’è una via d’uscita da queste difficoltà. Gli esseri umani affrontano esattamente gli stessi problemi, ma non li risolvono tutti in una volta.

I primi anni dell’infanzia mostrano incredibili progressi nello sviluppo, durante i quali impariamo a controllare il nostro corpo e a percepire e sperimentare oggetti, agenti e ambienti. Impariamo anche come agire e le conseguenze di atti e interazioni.

La ricerca nel nuovo campo della robotica dello sviluppo sta ora esplorando come i robot possono imparare da zero, come i neonati. Le prime fasi riguardano la scoperta delle proprietà degli oggetti passivi e della “fisica” del mondo dei robot. In seguito, i robot annotano e copiano le interazioni con gli agenti (badanti), seguite da una modellazione gradualmente più complessa del sé nel contesto.

Quindi, mentre l’IA disincarnata ha sicuramente un limite fondamentale, la ricerca futura con robot dal corpo fisico potrebbe un giorno contribuire a creare interazioni sociali durature ed empatiche tra l’IA e gli esseri umani.

__

Puoi approfondire l’articolo nella sua versione originale qui.