ChatGPT è un modello di linguaggio sviluppato da OpenAI, basato sulla tecnologia GPT (Generative Pre-trained Transformer). GPT è un tipo di modello di intelligenza artificiale che utilizza una vasta quantità di dati per apprendere il linguaggio naturale e generare testo in modo coerente e contestualmente appropriato.

ChatGPT è appositamente progettato per gestire conversazioni, rendendolo utile per una serie di applicazioni di chat e assistenza virtuale.

È addestrato su un ampio spettro di dati provenienti da varie fonti web, il che gli permette di comprendere e generare risposte su una vasta gamma di argomenti.

La tecnologia GPT-3, su cui si basa ChatGPT, è all’avanguardia nel campo dei modelli di linguaggio naturali e può essere utilizzata in diverse applicazioni, come chatbot, assistenti virtuali, creazione di contenuti e molto altro.

L’obiettivo principale è quello di fornire un’interazione più naturale e sofisticata tra gli utenti e i sistemi basati su intelligenza artificiale.

LEGGI ANCHE: Il vero potenziale dei robot

A cosa serve ChatGPT

ChatGPT, e modelli simili basati sulla tecnologia GPT (Generative Pre-trained Transformer), sono progettati per comprendere e generare linguaggio naturale. Le loro applicazioni sono diverse e possono includere:

- Chatbot e Assistenza Virtuale: ChatGPT può essere utilizzato per sviluppare chatbot avanzati e assistenti virtuali che possono rispondere a domande, fornire informazioni e interagire con gli utenti in modo più naturale.

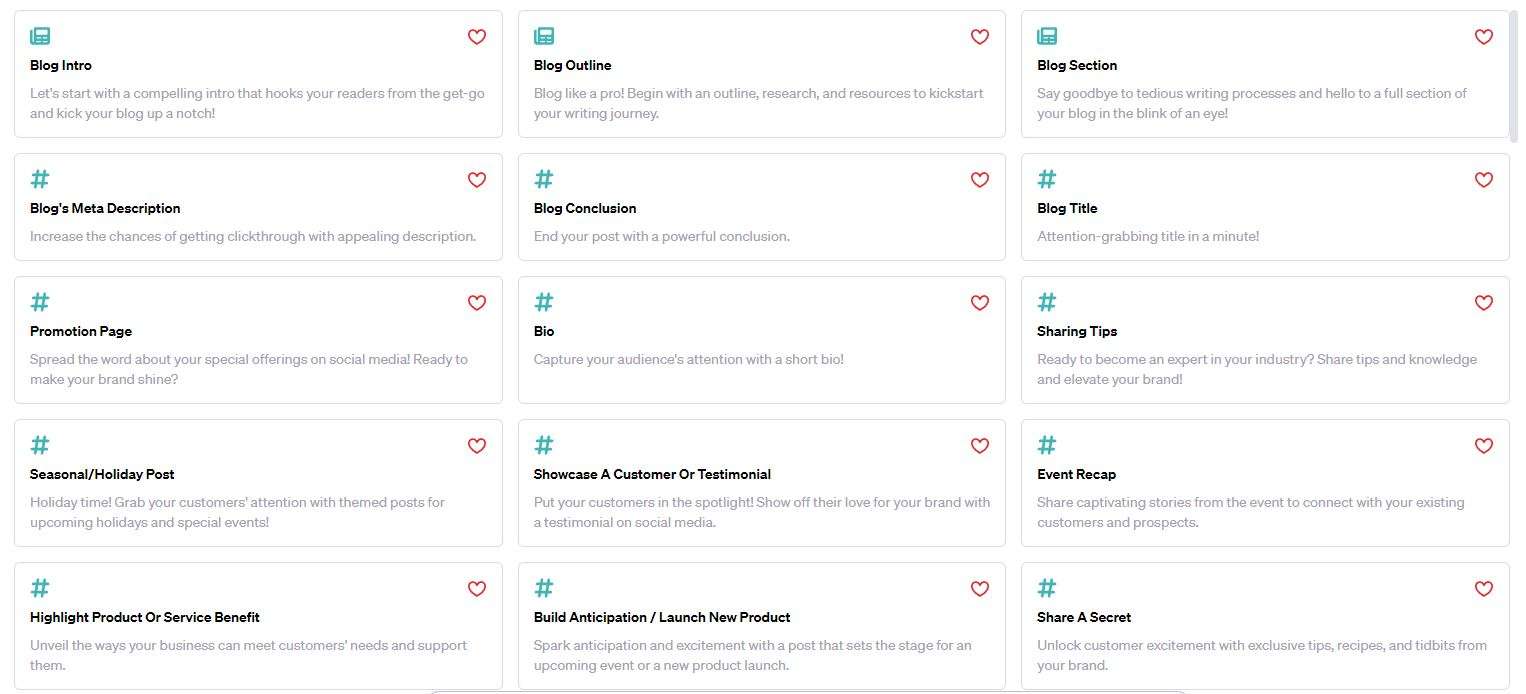

- Generazione di Contenuti: Può essere impiegato per creare automaticamente articoli, recensioni, descrizioni e altri tipi di contenuto scritto. Questo è utile in scenari in cui è richiesta una grande quantità di testo, come nel giornalismo, nella creazione di contenuti web o nella redazione automatica di documenti.

- Apprendimento Automatico: Può essere utilizzato come parte di sistemi di apprendimento automatico per migliorare la comprensione del linguaggio naturale e l’elaborazione del testo.

- Supporto alla Decisione: Modelli come ChatGPT possono essere integrati in sistemi di supporto decisionale per analizzare e interpretare dati testuali, rispondendo a domande complesse o fornendo suggerimenti.

- Formazione Linguistica: Possono essere utilizzati per migliorare le capacità linguistiche e la comprensione del contesto in applicazioni come la correzione automatica, il completamento automatico e altre funzionalità linguistiche.

- Esplorazione di Dati: ChatGPT può essere utilizzato come interfaccia conversazionale per esplorare e comprendere meglio set di dati complessi, semplificando l’analisi e l’interpretazione dei risultati.

- Educazione e Formazione: Può essere utilizzato per sviluppare strumenti educativi interattivi, simulazioni di conversazioni o tutor virtuali per migliorare l’apprendimento degli utenti.

- Interfaccia Uomo-Macchina: ChatGPT può essere integrato in applicazioni e dispositivi come un’interfaccia di conversazione, consentendo agli utenti di interagire con macchine, software o servizi utilizzando il linguaggio naturale.

In generale, l’obiettivo principale di ChatGPT è quello di facilitare l’interazione tra gli utenti e i sistemi basati sull’intelligenza artificiale, migliorando la capacità di comprendere e generare linguaggio naturale in modo contestualmente rilevante.

LEGGI ANCHE: L’umanizzazione dell’Intelligenza Artificiale: il transfert sulle macchine

Cosa sono gli LLM

LLM è l’acronimo di “Large Language Model” in inglese, che tradotto in italiano significa “Modello di Lingua Grande”. Si riferisce a modelli di intelligenza artificiale che sono stati addestrati su grandi quantità di dati testuali per comprenderne la struttura, la semantica e la grammatica. Gli LLM sono capaci di generare testo coerente e rispondere a domande in modo contestuale.

Esempi di LLM includono modelli come GPT-3 (Generative Pre-trained Transformer 3), BERT (Bidirectional Encoder Representations from Transformers) e altri simili.

Questi modelli possono essere utilizzati in una varietà di applicazioni, come chatbot, assistenti virtuali, generazione di testo automatica e altro ancora. GPT-3, in particolare, è uno dei LLM più grandi e avanzati disponibili, sviluppato da OpenAI

Chi ha creato ChatGPT

ChatGPT è stato creato da OpenAI, un’azienda di ricerca sull’intelligenza artificiale.

OpenAI è stata fondata nel 2015 con l’obiettivo di sviluppare tecnologie avanzate di intelligenza artificiale in modo sicuro e benefico per l’umanità.

L’organizzazione è stata coinvolta in diversi progetti e ha rilasciato diverse versioni di modelli di linguaggio, tra cui la serie GPT (Generative Pre-trained Transformer).

GPT-3, su cui si basa ChatGPT, è la terza iterazione di questa serie ed è uno dei modelli di linguaggio più avanzati e potenti mai creati fino alla mia ultima data di conoscenza nel gennaio 2022.

OpenAI ha continuato a sviluppare e rilasciare nuove versioni dei suoi modelli per migliorare le capacità di comprensione del linguaggio naturale e l’interazione conversazionale.

Cosa può fare ChatGPT

ChatGPT può essere utilizzato per una varietà di compiti legati al linguaggio naturale. Ecco alcune delle sue capacità principali:

- Risposta a Domande: Può rispondere a domande su una vasta gamma di argomenti, basandosi sulle informazioni apprese durante l’addestramento.

- Generazione di Testo: Può generare testo in modo coerente e contestualmente rilevante su diversi argomenti, adattandosi al tono e al contesto della conversazione.

- Chat Conversazionale: È progettato per interagire in modo conversazionale, rispondendo alle affermazioni, alle domande e mantenendo la coerenza nel contesto della conversazione.

- Creazione di Contenuti: Può essere utilizzato per scrivere articoli, descrizioni, recensioni e altri tipi di contenuti scritti in modo automatico.

- Traduzione del Linguaggio Naturale: Può essere impiegato per tradurre frasi o testo da una lingua all’altra.

- Tutoraggio Virtuale: Può fornire informazioni educative su vari argomenti, spiegando concetti o risolvendo problemi.

- Simulazioni di Personaggi Virtuali: Può essere integrato in videogiochi o applicazioni interattive per creare personaggi virtuali che rispondono alle interazioni degli utenti.

- Supporto alla Decisione: Può essere utilizzato per analizzare testo e fornire suggerimenti o informazioni utili per supportare decisioni in diversi contesti.

- Esplorazione di Dati: Può aiutare gli utenti a esplorare e comprendere grandi set di dati testuali in modo interattivo.

- Correzione Automatica e Completamento Automatico: Può essere utilizzato per correggere errori di ortografia e grammatica, oltre a completare frasi o testo in modo automatico.

È importante notare che, mentre ChatGPT è estremamente versatile, ha alcune limitazioni.

Può generare risposte basate sulle informazioni apprese durante l’addestramento, ma non ha comprensione del mondo reale o consapevolezza.

Inoltre, potrebbe generare risposte inaccurate o non verificate, pertanto è sempre consigliabile verificare le informazioni critiche.

Le alternative a ChatGPT

Ci sono diverse alternative a ChatGPT e altre implementazioni di modelli di linguaggio naturali basati sulla tecnologia transformer. Alcune delle alternative notevoli includono:

- BERT (Bidirectional Encoder Representations from Transformers): Sviluppato da Google, BERT è un modello di linguaggio preaddestrato che ha introdotto l’idea di comprensione bidirezionale del contesto, consentendo una migliore comprensione del significato delle parole in una frase.

- XLNet: Basato sulla struttura transformer, XLNet ha introdotto la permuted language modeling, che aiuta il modello a catturare relazioni più complesse tra le parole.

- T5 (Text-to-Text Transfer Transformer): Questo modello di Google è progettato per trattare tutte le attività di elaborazione del linguaggio naturale come problemi di text-to-text, unificando l’approccio per diversi compiti.

- RoBERTa (Robustly optimized BERT approach): Una variante di BERT che utilizza un metodo di preaddestramento più robusto e una maggiore quantità di dati, migliorando le prestazioni su alcune attività.

- ERNIE (Enhanced Representation through kNowledge Integration): Sviluppato da Baidu, ERNIE cerca di incorporare conoscenze esterne nei modelli di linguaggio per una comprensione più avanzata del contesto.

- GPT (Generative Pre-trained Transformer) di OpenAI: Prima dell’uscita di GPT-3, OpenAI ha rilasciato GPT-2, una versione precedente ma ancora potente del modello di linguaggio.

- CTRL (Conditional Transformer Language Model): Un modello di linguaggio sviluppato da Salesforce, progettato per generare testo condizionato a uno specifico stile o tono.

- DistilBERT: Una versione più piccola e più veloce di BERT, mantenendo comunque un’alta efficienza nelle prestazioni.

Ogni modello ha i suoi punti di forza e limitazioni, e la scelta di uno dipenderà dalle esigenze specifiche dell’applicazione.

Alcuni di essi sono specializzati in determinati compiti, mentre altri sono progettati per essere più versatili.

La scelta tra le alternative dipende dalle esigenze specifiche del progetto, dalle risorse disponibili e dalla complessità del problema che si vuole risolvere.

I punti critici

Ci sono diversi punti critici associati a modelli come ChatGPT:

- Mancanza di comprensione del contesto a lungo termine: Nonostante le dimensioni impressionanti e la complessità di modelli come ChatGPT, possono ancora avere difficoltà a mantenere una comprensione coerente del contesto a lungo termine. Questo può portare a risposte incoerenti o erronee, specialmente in conversazioni complesse.

- Tendenza alla generazione di contenuti non verificati o imprecisi: Modelli come ChatGPT generano risposte basate su modelli statistici e sui dati con cui sono stati addestrati, e ciò potrebbe portare alla generazione di informazioni non verificate o imprecise.

- Sensibilità agli input: I modelli di linguaggio possono essere sensibili agli input e alle frasi di provocazione, generando risposte inappropriate o offensive. Ciò evidenzia la necessità di una moderazione attiva nell’implementazione di questi modelli in applicazioni del mondo reale.

- Bias nei dati di addestramento: Se i dati di addestramento contengono bias, il modello può replicare e amplificare tali bias nelle risposte generate. Ciò solleva preoccupazioni etiche riguardo all’equità e alla rappresentazione.

- Mancanza di comprensione del significato: Anche se i modelli come ChatGPT possono generare risposte linguisticamente corrette, potrebbero mancare di una comprensione profonda del significato dei concetti. Possono rispondere correttamente superficialmente senza comprendere appieno il contesto o la sostanza delle domande.

- Rischio di generazione di contenuto inappropriato: I modelli possono generare contenuti inappropriati o offensivi, specialmente se esposti a dati inappropriati durante l’addestramento o se manipolati attraverso input intenzionalmente provocatori.

- Elevato consumo di risorse: Modelli di linguaggio complessi come ChatGPT richiedono considerevoli risorse computazionali per l’addestramento e l’esecuzione. Ciò può limitarne l’accessibilità e l’utilizzo in alcuni contesti.

È importante affrontare questi punti critici attraverso l’implementazione di controlli di sicurezza, la moderazione attiva, l’adeguata gestione dei dati di addestramento e la consapevolezza delle limitazioni del modello.

Cosa sono le allucinazioni di Chat Gpt

Le “allucinazioni” in riferimento a ChatGPT o modelli simili di linguaggio si riferiscono al fatto che possono generare risposte che sembrano plausibili, coerenti e logicamente corrette, ma che non si basano su fatti reali.

Questo fenomeno può essere attribuito alla natura statistica e probabilistica dell’addestramento di questi modelli su grandi quantità di dati testuali.

Quando si chiede a un modello come ChatGPT di generare del testo su un certo argomento, esso tenterà di produrre una risposta che abbia senso all’interno del contesto fornito. Tuttavia, se l’informazione specifica richiesta non è presente nei dati di addestramento o se il modello non riesce a discernere la corretta risposta, può generare una risposta che sembra credibile ma che potrebbe essere completamente inventata o fuorviante.

È importante notare che i modelli di linguaggio come ChatGPT non hanno una comprensione intrinseca del mondo reale e delle informazioni verificate; essi si basano su modelli probabilistici basati sui dati di addestramento.

Pertanto, le “allucinazioni” rappresentano una limitazione fondamentale di tali modelli e sottolineano la necessità di verificare le informazioni generate da essi attraverso fonti affidabili.

ChatGPT può generare contenuti inappropriati?

Sì, ChatGPT può generare contenuti inappropriati.

A causa della natura statistica del suo addestramento su una vasta gamma di dati testuali provenienti da Internet, il modello può riflettere e riprodurre i pregiudizi, i bias e le espressioni inappropriate presenti nei dati di addestramento. Inoltre, potrebbe rispondere in modo indesiderato a input provocatori o ambigui.

OpenAI, l’organizzazione dietro ChatGPT, ha implementato diverse misure per mitigare questo rischio. Tuttavia, a causa della complessità e della diversità delle interazioni linguistiche, non è possibile eliminare completamente la possibilità di generare contenuti inappropriati.

È importante sottolineare che la moderazione e il controllo sono essenziali quando si utilizzano modelli di linguaggio come ChatGPT in contesti pubblici o in applicazioni dove la generazione di contenuti appropriati è fondamentale.

Gli utenti e gli sviluppatori dovrebbero adottare politiche di moderazione robuste per gestire eventuali risposte inadeguate e contribuire a migliorare la sicurezza e l’appropriatezza dell’uso di tali modelli.

La storia di ChatGPT

La storia di ChatGPT è strettamente legata alla serie GPT (Generative Pre-trained Transformer) sviluppata da OpenAI. Ecco una panoramica della storia di base:

- GPT-2 (2019): La serie GPT ha inizio con GPT-2, un modello di linguaggio preaddestrato basato sulla trasformazione del linguaggio naturale. Rilasciato nel 2019, GPT-2 ha mostrato notevoli capacità nella generazione di testo e nell’elaborazione del linguaggio naturale. OpenAI ha inizialmente esitato a rilasciare il modello completo a causa delle preoccupazioni sulla possibile generazione di contenuto dannoso o ingannevole. Successivamente, nel novembre 2019, OpenAI ha pubblicato il modello completo per uso pubblico.

- GPT-3 (2020): GPT-3 rappresenta un ulteriore miglioramento in termini di dimensioni e capacità rispetto a GPT-2. Rilasciato nel giugno 2020, GPT-3 è diventato uno dei modelli di linguaggio più avanzati e potenti mai creati fino a quel momento. Era composto da 175 miliardi di parametri, consentendo una notevole flessibilità e adattabilità a una vasta gamma di compiti di elaborazione del linguaggio naturale.

- ChatGPT (2020 – 2021): OpenAI ha introdotto ChatGPT come un’applicazione specifica basata su GPT-3. Ha lanciato una versione iniziale di ChatGPT tramite il sito web “chat.openai.com” nel novembre 2020. Tuttavia, questa versione aveva alcune limitazioni e problemi di sicurezza, e l’accesso era inizialmente limitato. Successivamente, OpenAI ha lanciato una versione migliorata chiamata ChatGPT Plus a pagamento nel febbraio 2021, offrendo vantaggi come l’accesso prioritario, tempi di risposta più veloci e assistenza prioritaria.

- Esperimenti e Utilizzo Comunitario: Dopo il rilascio iniziale di ChatGPT, OpenAI ha incoraggiato gli sviluppatori a sperimentare con il modello attraverso API e ha ospitato diverse competizioni per incentivare la comunità a esplorare nuove applicazioni e miglioramenti.

È importante notare che la storia di ChatGPT è solo una tappa nella continua evoluzione delle tecnologie di intelligenza artificiale basate su modelli di linguaggio preaddestrati. OpenAI potrebbe sviluppare ulteriori iterazioni o modelli in futuro per affrontare sfide specifiche o migliorare ulteriormente le prestazioni.

Chi è Sam Altman

Sam Altman è un imprenditore e investitore statunitense, noto per il suo ruolo di CEO di OpenAI e per essere stato presidente di Y Combinator, un’importante incubatrice di startup.

Ecco alcuni punti salienti della sua carriera:

- Y Combinator: Sam Altman è diventato presidente di Y Combinator nel 2014, subentrando a Paul Graham. Y Combinator è una delle più prestigiose incubatrici di startup al mondo, fornendo mentorship, finanziamenti e risorse alle nuove imprese emergenti.

- OpenAI: Nel marzo 2019, Sam Altman è diventato co-presidente di OpenAI insieme a Greg Brockman. Successivamente, è diventato l’unico CEO di OpenAI quando Greg Brockman è stato nominato Chairman. OpenAI è un’organizzazione di ricerca sull’intelligenza artificiale focalizzata su progetti avanzati nel campo dell’IA e sulla promozione di sviluppi sicuri e benefiche nell’ambito dell’intelligenza artificiale.

- Lavoro Precedente: Prima di Y Combinator, Sam Altman ha fondato Loopt, una startup nel settore dei social network e della localizzazione, nel 2005. Loopt è stato acquisito da Green Dot Corporation nel 2012. Altman è stato anche coinvolto in altre iniziative imprenditoriali e ha guadagnato reputazione come investitore di successo.

- Investimenti: Sam Altman è noto per i suoi investimenti in numerose startup di successo, ed è stato coinvolto in varie fasi di finanziamento di molte aziende emergenti.

- Educazione: Altman ha frequentato la Stanford University, ma ha abbandonato gli studi per concentrarsi sulla sua carriera imprenditoriale.

Sam Altman è riconosciuto come una figura di spicco nell’ecosistema delle startup e dell’innovazione tecnologica, contribuendo sia come imprenditore che come investitore.

La sua leadership in Y Combinator e OpenAI riflette il suo interesse per l’avanzamento tecnologico e l’intelligenza artificiale.